M365 véritable outil catalyseur du travail collaboratif, devant répondre à l’augmentation des menaces internes qui en découlent.

L’importance de la suite M365 en entreprise

La suite logicielle Microsoft 365 offre un ensemble de services collaboratifs primordial pour les entreprises (figure 1). Ces services collaboratifs manipulant un volume important de données, potentiellement sensibles, ont besoin d’être sécurisés notamment grâce à de l’outillage. Microsoft a donc mis à disposition un panel de produits de sécurité, permettant de réduire ces risques.

Figure 1 – Les fonctionnalités de la suite M365.

Des menaces internes souvent oubliées mais de plus en plus présentes

Les tenants M365 au même titre que n’importe quel système informatique, représentent évidemment une cible potentielle pour les attaquants externes. Il ne faut pourtant pas sous-estimer la menace interne, d’autant plus que la proportion et l’impact de ces dernières ne sont pas négligeables. En effet, en 2020 en Amérique du Nord, près de 19% des acteurs de menace[1] proviennent de l’intérieur de l’entreprise. On peut distinguer différentes catégories de menaces internes :

- Le sabotage qui désigne un collaborateur interne utilisant ses accès légitimes pour endommager ou détruire les systèmes ou les données de l’entreprise afin de nuire à l’entreprise ;

- La fraude, représentée par la modification ou la destruction de données par un initié dans le but d’en tirer des avantages personnels ;

- Le vol de données où l’initié vole la propriété intellectuelle de l’entreprise dans le but de la revendre ou de la garder pour lui-même dans le cadre d’un prochain emploi. L’initié peut également voler des informations pour une autre organisation (concurrents ou gouvernements par exemple), dans le but de réaliser de l’espionnage industriel ou gouvernemental ;

- La maladresse qui provient d’erreurs ou d’actions involontaires réalisées par un collaborateur négligent.

On associe également à ces menaces les acteurs potentiels :

- Les employés malintentionnés ayant pour but de réaliser des actes de sabotage (par exemple modification ou suppression de données).

- Les employés quittant une entreprise, particulièrement s’ils la quittent de manière forcée. Dans ce cas, la plus grande menace associée est le vol de données. D’après une étude[2], 70% des employés déclarent emporter avec eux le travail qu’ils ont produit pour l’entreprise, alors qu’il ne leur appartient pas.

- L’agent interne qui est une personne travaillant pour un groupe externe afin de leur permettre d’accéder aux ressources de l’entreprise. Ces personnes peuvent avoir été sujette à des méthodes de corruption ou même de chantage.

- Les personnes désobéissantes qui contournent les politiques de sécurité mises en place par une entreprise, par exemple en utilisant des solutions personnelles de stockage de données en ligne, créant ainsi un risque de fuite de donnée.

- Les travailleurs externes qui ne sont pas des employés mais qui sont amenés à accéder au système d’information de l’entreprise (prestataires, fournisseurs, partenaires…).

- Les travailleurs négligents, qui n’ont pas conscience que leurs actions induisent des vulnérabilités pour l’entreprise. En effet, dans la majorité des cas, les failles de sécurité impliquant un employé ne sont pas intentionnelles, mais proviennent de travailleurs négligents (dans 56% des cas en 2021[3]). Par exemple, un employé peut perdre ou se faire voler un appareil non chiffré possédant des données sensibles pouvant mettre en danger l’entreprise. Ou tout simplement partager des fichiers aux mauvaises personnes ou supprimer des objets importants sans s’en rendre compte.

La réponse de Microsoft face à ces menaces internes

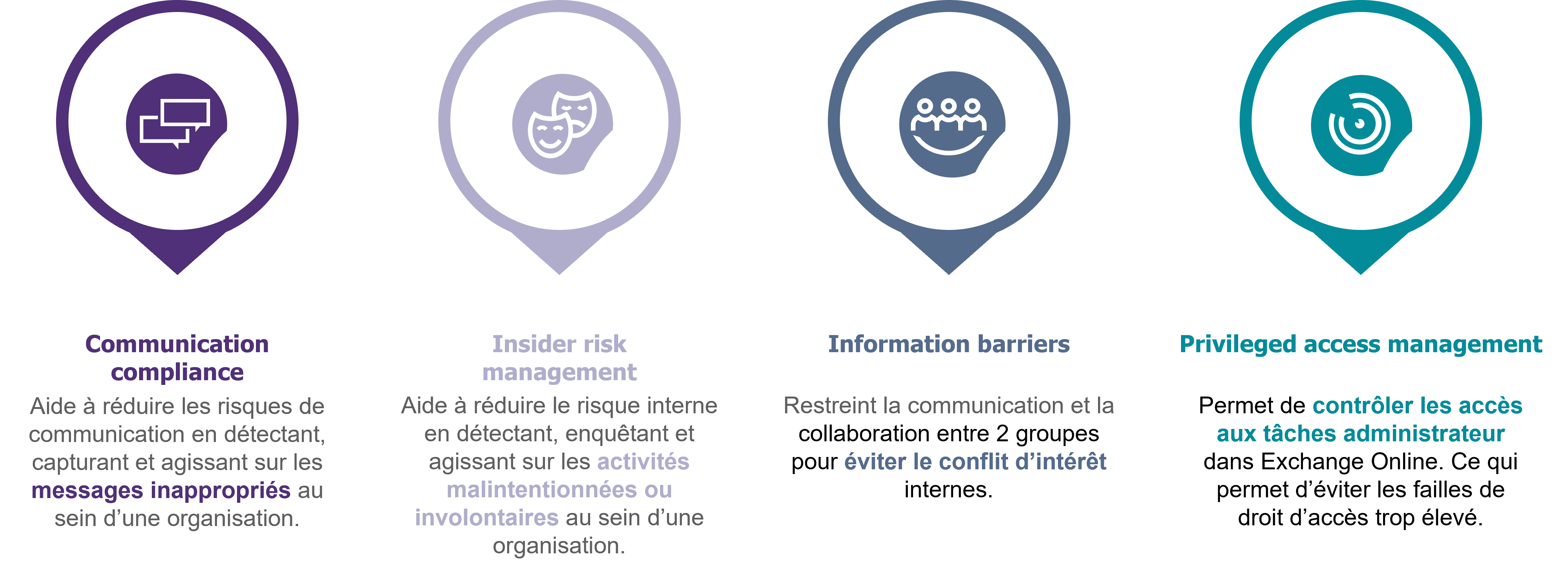

Un des défis de Microsoft aujourd’hui, est d’accompagner ses clients à se prémunir face aux risques internes. Actuellement, Microsoft propose un groupe de solutions pour lutter contre les menaces internes appelé : « Microsoft Purview », anciennement nommé « compliance center » (voir figure 2[4]).

Ce groupe inclut

- « Communication compliance» : minimiser les risques de communication en permettant de détecter, de capturer et d’agir sur les messages à risque au sein d’une organisation ;

- « Information barriers» : restreindre la communication et la collaboration entre 2 groupes pour éviter les conflits d’intérêt internes ;

- « Privileged access management» : contrôler les accès aux taches administrateur dans Exchange Online permettant d’éviter les droits d’accès trop élevés.

Enfin, Microsoft Purview est aussi nouvellement composé du module « Insider Risk Management » (IRM). Ce module, aide à minimiser les risques internes en permettant de détecter, d’enquêter et d’agir sur des activités malintentionnées ou involontaires au sein d’une organisation.

Figure 2 – Les modules de gestion de menaces internes de Microsoft.

Insider Risk Management, la solution Microsoft qui aide les organisations à traiter une partie de ces menaces internes.

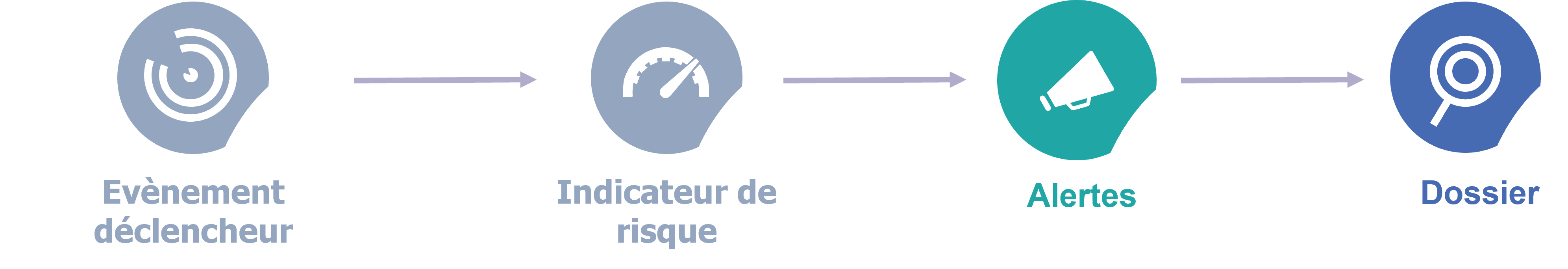

Comme expliqué précédemment, IRM aide à minimiser les risques internes. Concrètement, l’outil fonctionne en différentes phases (qui seront détaillées par la suite) et repose sur des données provenant des flux de travail Microsoft. Il comporte des scénarios de fuite de données pré établis comme la démission d’un employé ou son mécontentement. Ces scénarios facilitent l’analyse des activités à risque en apportant du contexte. L’outil va pouvoir utiliser des métadonnées liées au scénario ciblé, comme les dates de départ ou d’entretien annuel d’un employé par exemple. Ainsi il va pouvoir évaluer le niveau de risque des utilisateurs et générer des alertes au moment approprié.

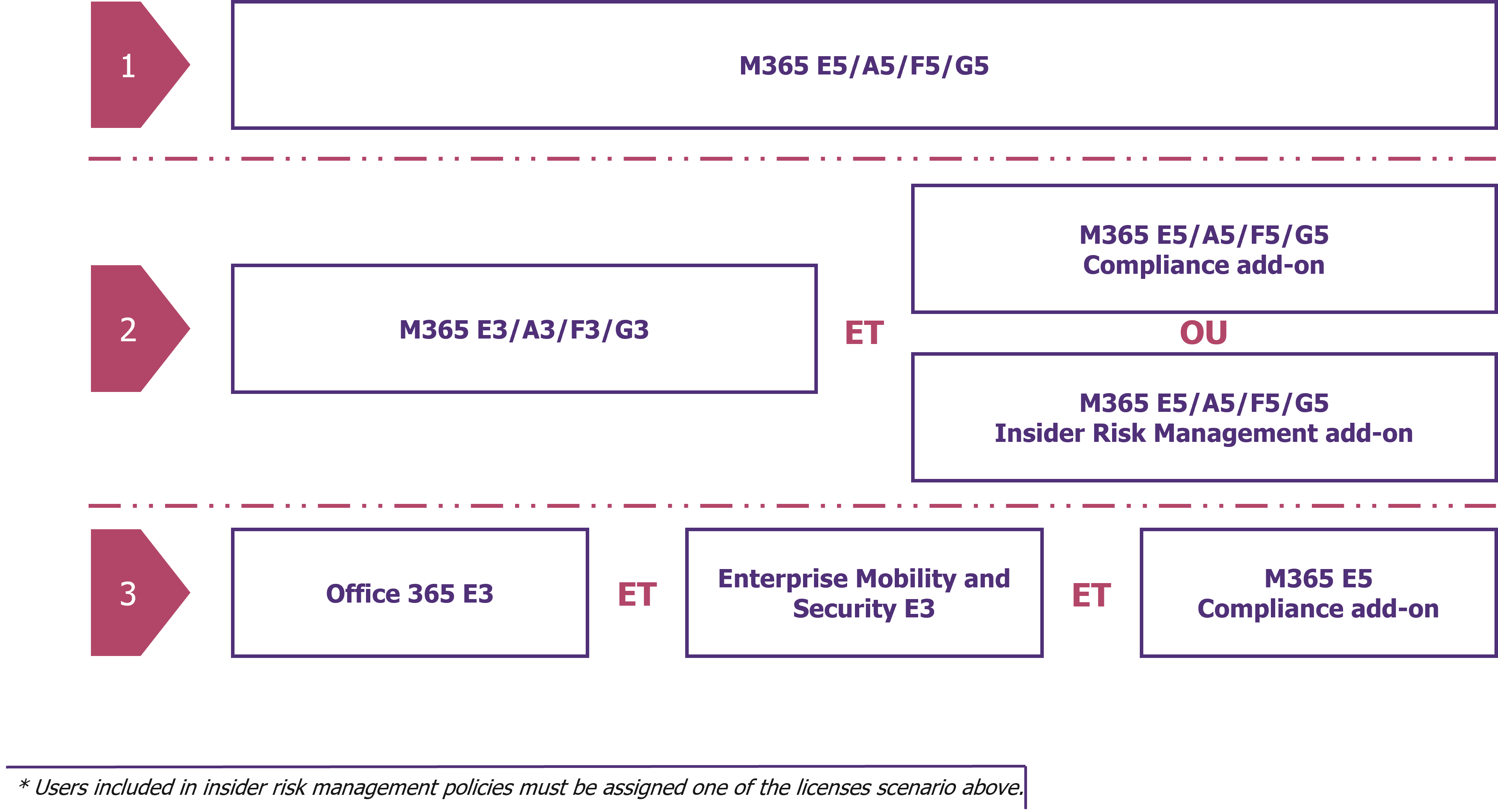

Pour cela, Insider Risk Mangement utilise différents modules de M365. IRM est une solution avancée et nécessite donc des licences spécifiques. Pour pouvoir utiliser ce module, il existe plusieurs possibilités de licensing :

Figure 3 – Trois façons d’obtenir Insider Risk Management avec les licences Microsoft.

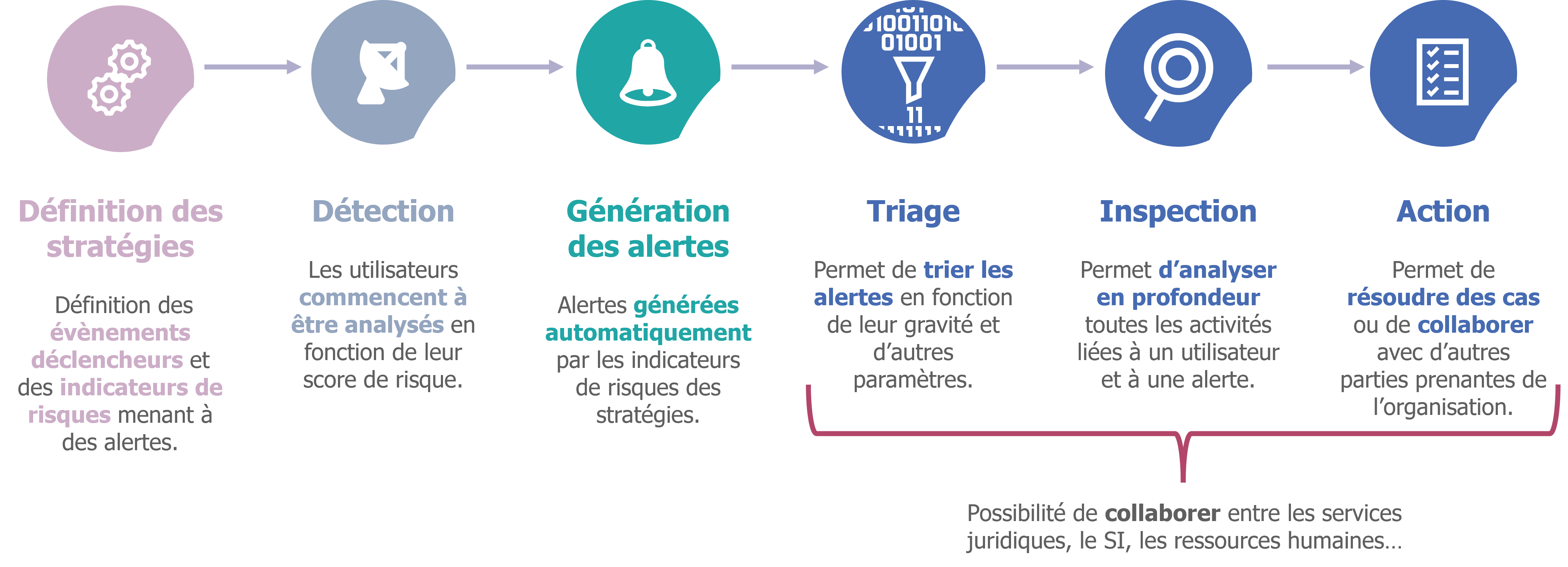

Un outil qui fonctionne en 6 phases

La première est la phase de création de stratégies, elle permet de définir les évènements déclencheurs et les indicateurs de risques menant à la génération d’alertes.

La deuxième est la détection, lorsque les activités d’un utilisateur commencent à être analysées par IRM à la suite d’une activité suspicieuse (évènement déclencheur).

La troisième est une phase de génération des alertes, elles sont générées automatiquement par les indicateurs de risques définis dans les stratégies.

Une fois qu’une alerte est levée, IRM met à disposition une étape de triage qui permet aux administrateurs de classifier les alertes en fonction de leur niveau de gravité et d’autres paramètres.

Vient ensuite la phase d’inspection qui permet d’analyser en profondeur toutes les activités liées à un utilisateur et à une alerte grâce à la création d’un dossier d’analyse en profondeur (« case »).

Une fois que l’alerte a été traitée, la phase d’action intervient. Elle consiste à résoudre le dossier d’analyse, soit en alertant l’utilisateur d’un comportement inhabituel, soit en alertant les parties prenantes de l’organisation (services juridiques, SI, ressources humaines, etc.) pouvant prendre les mesures adéquates.

Figure 4 – Les 6 phases de fonctionnement d’IRM.

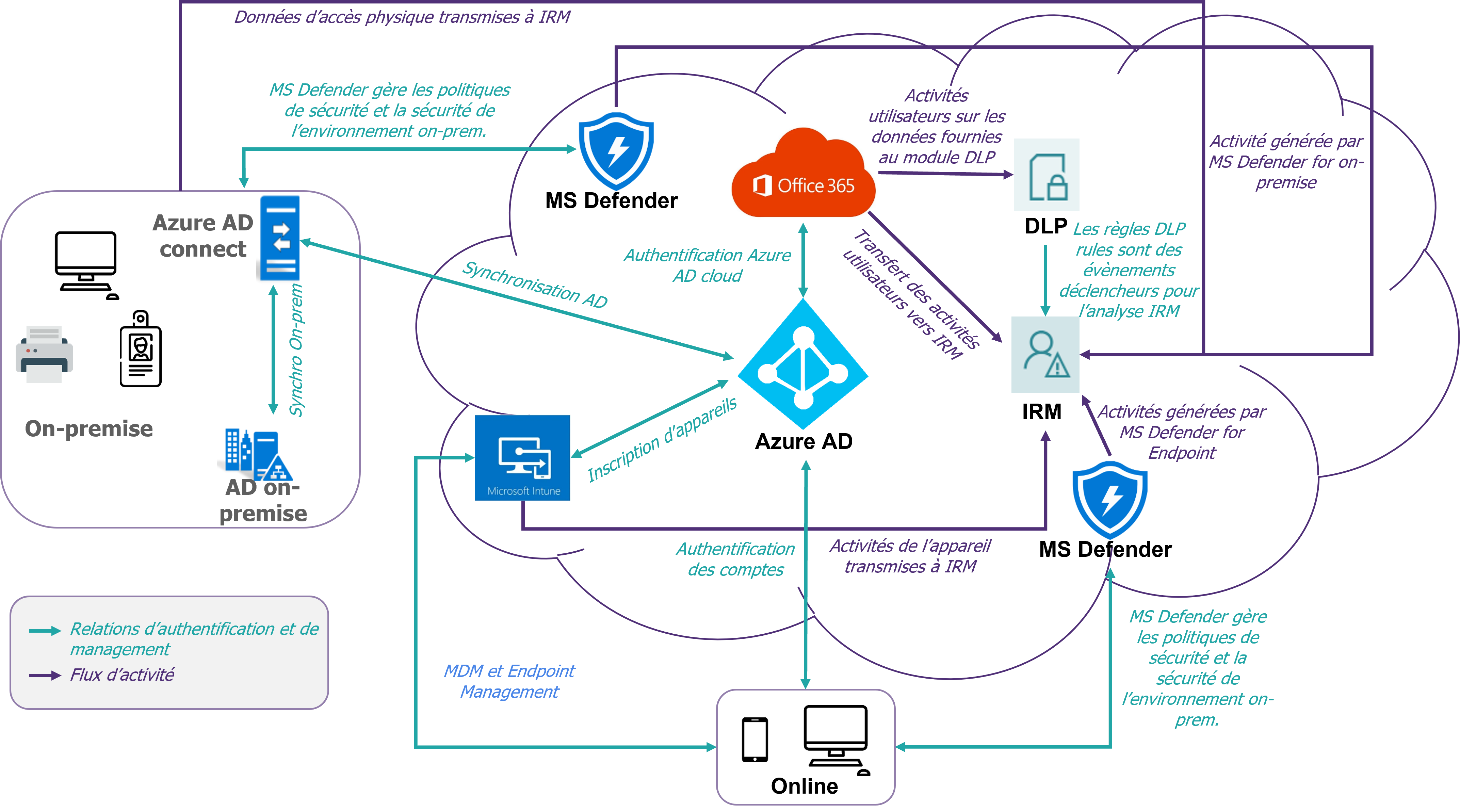

Pour fonctionner, Insider Risk Management s’intègre pleinement avec les composantes M365 du tenant sur lequel il est déployé (voir schéma en figure 5). En effet, les données reçues d’autres modules permettent l’analyse des flux de travail et des différentes activités.

Figure 5 – Schéma d’architecture global d’IRM.

Pour commencer, définir les stratégies de détection

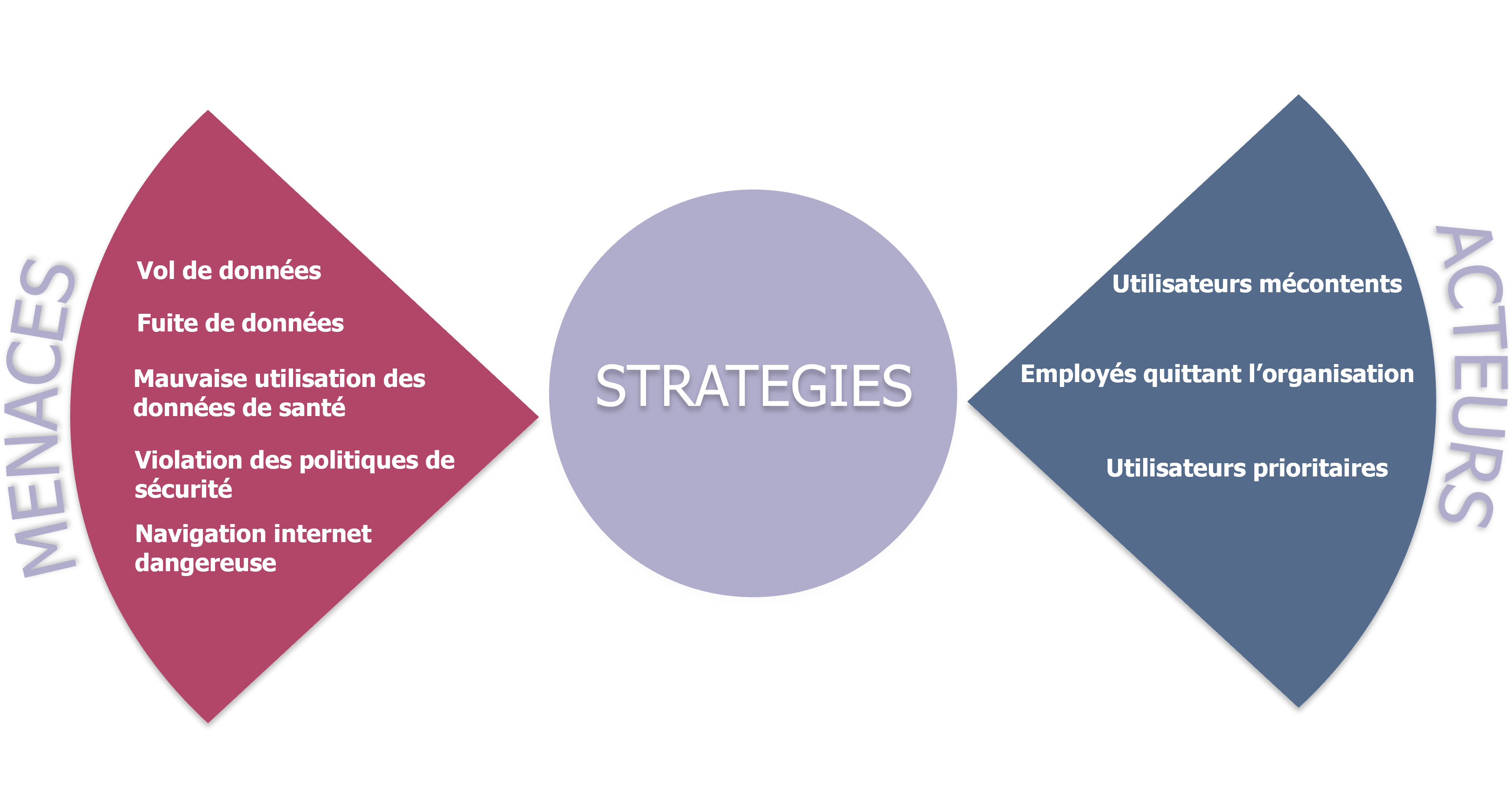

Comme présenté précédemment, la première étape est la définition des stratégies, qui s’appuient sur un des 5 scénarios établis par Microsoft :

- Vol de données: Lutte contre le vol des données de l’entreprise dans le but d’en tirer un profit ou un intérêt personnel. Ce scénario s’applique aux utilisateurs quittant l’entreprise (volontairement ou non).

- Fuite de données: Lutte contre le partage intentionnel ou non d’informations sensibles.

- Utilisation abusive de données de santé: Lutte contre l’exploitation illégale d’informations de santé par des employés.

- Violation des politiques de sécurité: Lutte contre l’installation de logiciels malveillant et la désinstallation ou désactivation de certains services.

- Utilisation dangereuse des navigateurs: Détecte les comportements de navigation qui pourraient ne pas être acceptables par la charte de l’entreprise (visite de sites incitant à la haine, avec du contenu pour adultes) ou présentant une menace (sites de phishing).

Ces scénarios sont disponibles sous forme de « templates » pour alimenter les stratégies et peuvent inclure tout type d’utilisateur d’une organisation, mais IRM permet d’être plus précis et d’apporter plus de sens et de contexte en ciblant des catégories d’utilisateurs spécifiques. Voici les 3 types d’acteurs proposés par Microsoft :

- Les utilisateurs mécontents: Le comportement de l’employé peut être influencé par de nombreux événements tels que l’évaluation des performances ou les changements d’organisation (notamment la « rétrogradation » dans l’organisation). Pour ce faire IRM permet d’importer des données liées à la performance et à l’organisation.

- Les employés quittant l’entreprise: Un employé peut changer de société ou être licencié et donc devenir une menace pour l’organisation pour laquelle il travaillait.

- Les utilisateurs prioritaires: Utilisateurs avec un accès privilégié ou avec des responsabilités à haut risque.

Pour détecter ces cas, IRM permet d’importer des données depuis les outils RH (évaluation, organisation, démissions, licenciement), et des données liées aux habilitations des utilisateurs.

Figure 6 – Les composantes d’une stratégie de gestion des risques internes

La définition des stratégies de détection (scénarios et acteurs), permet de configurer la liste des évènements déclencheurs associée.

Si on prend pour exemple, le scénario « fuite de données », il regroupe un ensemble d’indicateurs et d’évènements déclencheurs permettant de prévenir des fuites de données accidentelles et intentionnelles. Mais en fonction des utilisateurs visés par cette stratégie, les indicateurs et les évènements déclencheurs seront différents (voir tableau ci-dessous). Dans cet exemple, la stratégie peut s’appliquer à tous les utilisateurs, à des utilisateurs prioritaires (groupe d’utilisateurs travaillant sur des données sensibles par exemple) ou à des utilisateurs mécontents (focus réalisé sur des utilisateurs ayant vu leur promotion refusée par exemple). Le mécanisme de détection et l’importance des indicateurs et des évènements déclencheurs propres aux profils d’utilisateurs sélectionnés sont détaillés dans la suite de cet article.

|

|

Tous les utilisateurs |

Utilisateurs prioritaires |

Utilisateurs mécontents |

|

Evènements déclencheurs |

|

|

|

|

Indicateurs |

|

|

|

Ensuite, détecter les activités douteuses

Une fois la phase de création de stratégie effectuée, la phase de détection (figure 7) permet de générer des alertes. Cette étape est la plus importante pour détecter les comportements malicieux. Il est à noter, que sans événement déclencheur présent dans une stratégie de gestion des risques internes, les activités des utilisateurs ne sont pas analysées par IRM. Les évènements déclencheurs sont liés au scénario de détection choisi. Comme dit précédemment cela peut être une date de démission ou bien des activités massives d’exfiltration (impressions, téléchargements, copie vers USB, envoie de mail, etc.) ou de suppression. Les évènements déclencheurs peuvent également être une suite d’action, par exemple lorsqu’un fichier est téléchargé, puis exfiltré et enfin supprimé.

Figure 7 – Focus sur le processus de détection.

Une fois qu’un utilisateur a réalisé un évènement déclencheur, il devient la cible de la stratégie de détection associée. A partir de ce moment-là, les activités des utilisateurs définies dans cette stratégie par les indicateurs de risques sont analysées. Les indicateurs de risques peuvent être des indicateurs liés aux activités Office (manipulation de fichiers sur SharePoint, OneDrive, Teams…), aux activités sur les appareils (impression, renommage, création de fichiers cachés, utilisation de clé USB, installation de logiciels…), aux activités de navigation (accès à des sites malveillants, contenu dangereux…) et aux activités des autres applications cloud (grâce à Microsoft Defender for Cloud Apps). Si un de ces indicateurs dépasse un certain seuil (défini via la stratégie), alors une alerte est générée et si l’alerte est confirmée par un administrateur IRM comme n’étant pas un faux-positif, un dossier est ouvert pour pouvoir analyser de manière détaillée les activités de l’utilisateur ciblé.

Enfin, traiter les alertes générées

Lorsqu’une menace est confirmée et qu’un dossier d’analyse en profondeur a été ouvert, les administrateurs IRM et les « global admins » peuvent alors observer le contenu qui a été téléchargé, partagé, imprimé, consulté, etc. Ce qui permet alors aux parties prenantes de prendre une décision sur l’action à mener face à la menace. On peut soit envoyer une notification à l’utilisateur concerné soit remonter le cas à des fins d’enquête. Cependant, il est important de rappeler qu’Insider Risk Management, ne permet pas de restreindre les agissements d’un utilisateur malveillant, cela reste un outil d’alerte et d’inspection facilitant la prise de décision.

Dans les faits IRM est une solution puissante et prometteuse mais pas encore assez mature

Bien qu’Insider Risk Management nécessite une bonne compréhension de l’ensemble des services M365 et de l’Azure AD, il permet d’exploiter les capacités des services de sécurité afin d’offrir une meilleure protection contre les menaces internes. Comme décrit précédemment, Insider Risk Management est un outil très efficace, qui analyse l’ensemble des flux de travail et qui s’adapte facilement aux activités des entreprises et des utilisateurs.

Cependant, certains points restent à éclaircir et à améliorer. En effet, l’efficacité d’IRM est contrastée par son temps de réaction assez élevé (environ 12h pour détecter les activités) et son interface qui n’est pas assez intuitive. Également, la documentation Microsoft peut s’avérer compliquée à comprendre voir fausse dans certains cas (mauvais format des dates proposé pour les données RH par exemple). De plus, dans la situation actuelle, les scénarios présentés pourraient être surveillés par les équipes du SOC d’une entreprise (via des scripts spécifiques, ou des alertes par exemple). C’est pourquoi l’outil est encore peu utilisé par les entreprises. Néanmoins, l’évolution de la maturité de cet outil doit être surveillée avec attention, puisque des changements réguliers y sont apportés (comme l’ajout de nouveaux scénarios de détection).

En conclusion, quelles questions se poser avant de se lancer ?

Définir les cas d’usages concrets à couvrir et évaluer la plus-value par rapport à l’alerting existant (au sein du SOC).

Evaluer l’impact de cet outil sur les données personnelles, compte tenu de sa puissance d’exploitation.

Réfléchir à l’organisation à mettre en œuvre (responsabilités, processus de traitement des alertes, processus d’évolution des stratégies).

[1] Source : 2021 Data Breach Investigations Report de Verizon (lien).

[2] Source : Article « What happens to your data when a departing employee leaves? » sur S2|DATA (lien).

[3] Source : 2022 Cost of Insider Threats Global Report de Ponemon Institute (lien).

[4] D’après la documentation Microsoft sur le produit Insider Risk Management.